En décembre 2016, les designers de Facebook ont lancé une série de mesures pour améliorer le Newsfeed et alerter les utilisateurs lorsqu’ils s’apprêtent à partager de fausses informations. Quelques changements ont été effectués à la suite de cette expérience:

- L’interface a été modifiée pour permettre de dénoncer les fausses infos plus facilement

- Des partenariats ont été mis en place avec des titres de presse pour débusquer les fausses infos

- La distribution de ces fausses infos ont été réduites

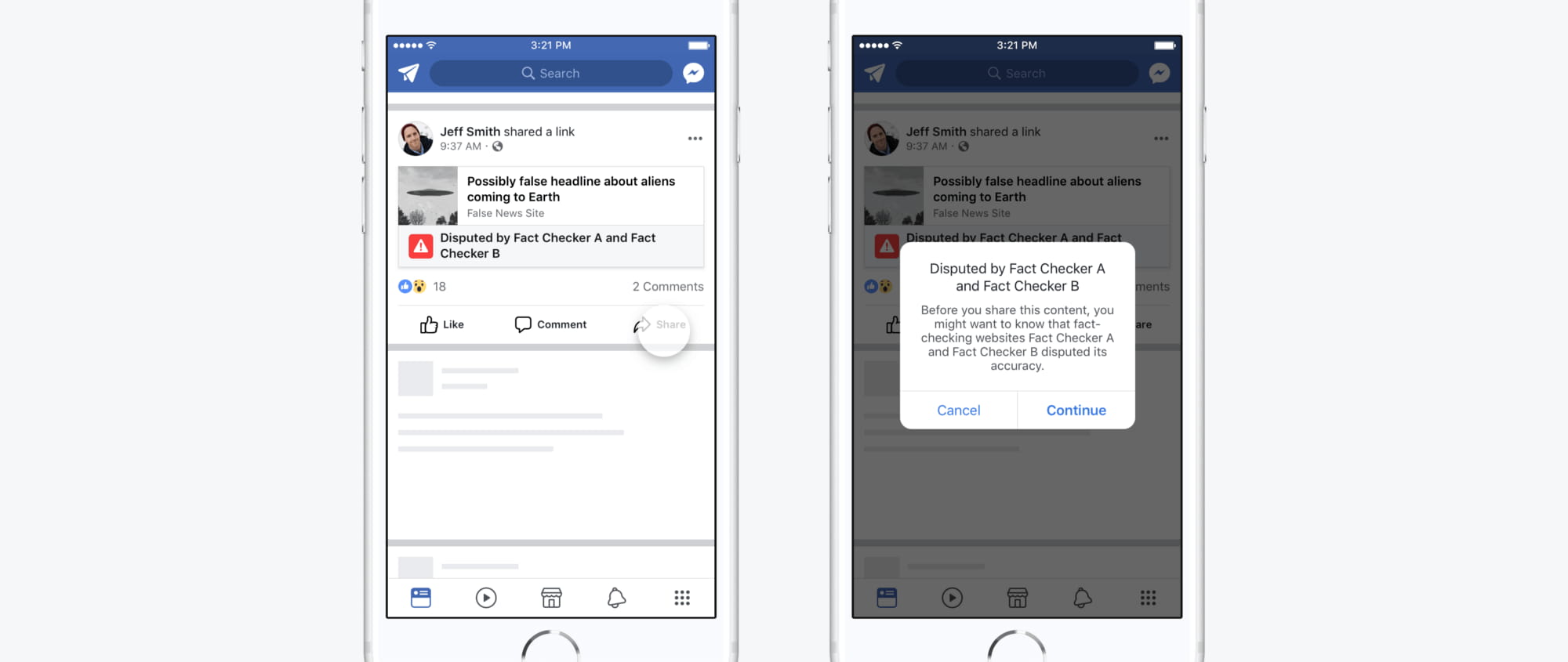

- Des outils d’alerte des utilisateurs ont été mis en ligne pour mieux renseigner sur la nature du contenu partagé.

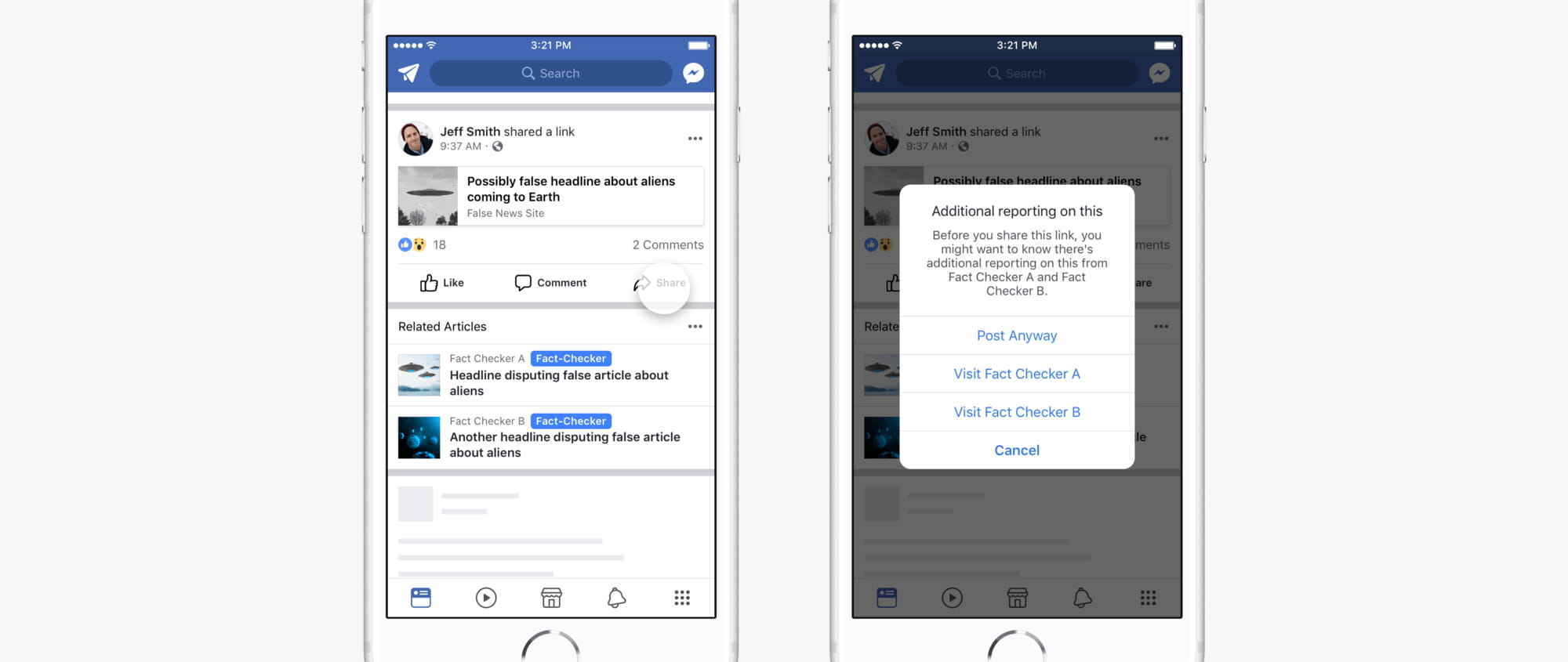

Malgré ces initiatives, Facebook a découvert après enquêtes sur le terrain que leur outil de signalement pouvait porter à confusion. Les fausses informations peuvent être difficilement identifiables, le label “fake news” ne suffit pas à faire changer d’avis les utilisateurs sur la crédibilité de l’info, il faut au moins deux “fact-checkers” pour s’assurer que l’info est bien fausse, le label “fausses infos” manque de nuances. Facebook a donc décidé d’agir et d’affiner sa méthode d’alerte en offrant plus d’options de contextualisation.

En guise de contre-attaque, Facebook va désormais utiliser son outil “Related Articles” (les articles connexes) pour donner plus de contexte à une fausse information. Un petit popin alertera l’utilisateur de la véracité douteuse de l’article qu’il s’apprête à partager et lui donnera le choix entre deux articles provenant d’éditeurs de référence. Facebook reconnait que la première des motivations pour diffuser de fausses infos sur le réseau est économique, en tentant de décourager la lecture de ces posts, la compagnie de Menlo Park espère couper près de 80% des revenus publicitaires des éditeurs d’infos toxiques et ainsi décourager l’utilisation du réseau à des fins douteuses.

- LIRE L’ARTICLE ORIGINAL: Designing against Misinformation on Medium

- ÉCOUTER LE PODCAST: Les Fake News, les GAFAs et Nous