Le 24 février dernier, Vladimir Poutine déclenchait une offensive contre l’Ukraine. Ce nouveau théâtre d’opérations verra-t-il la montée en force des deepfakes ? Les médias synthétiques vont-ils jouer un rôle dans la guerre de désinformation qui se joue sur le terrain ?

▾

🚨 MISE À JOUR LE 16 MARS 2022:

Deux semaines après l’invasion de l’Ukraine par la Russie, un deepfake du président ukrainien, Vlodomir Zelensky, est diffusé sur les réseaux sociaux pour annoncer la reddition de l’Ukraine. Une première dans l’histoire des médias synthétiques. Si la source de la vidéo est pour le moment inconnue et pour tout dire difficilement identifiable, elle apparait clairement pro-Russe. Le deepfake en lui-même n’est particulièrement bien réalisé. Le corps est statique, le cou trop grand comparé à celui du vrai Zelensky et le visage toujours face caméra trahie par sa rigidité les mécaniques de manipulations employées pour réaliser des hypertrucages bon marché.

Si un regard attentif permet de détecter la supercherie, il n’est pas impossible que sous les obus de l’artillerie russe, au fond d’une cave ou entre deux détonations, la vidéo puisse créer une certaine confusion. Dans ce cas précis, le gouvernement avait prévenu à travers différentes campagnes sur les réseaux sociaux de l’imminence d’attaques de cyberpropagande. Elles ont très vite réagi à la publication du deepfake, Zelensky lui-même a posté une vidéo pour démentir les propos tenus dans l’extrait ci-dessous. Les médias occidentaux ont quant à eux rapidement identifié la supercherie. Mais le génie vient d’être libéré. Les deepfakes prennent désormais place dans le panthéon des techniques de propagande en temps de guerre et nul doute qu’ils seront réutilisé, plus tard, dans les mêmes fins.

Le deepfake de Vlodomir Zelensky est le premier à être utilisé à des fins d’arme de manipulation

Les deepfakes inquiètent depuis 4 ans. Quatre ans pendant lesquels, médias et experts se sont relayés pour alerter sur le potentiel néfaste des médias synthétiques. La vidéo de Jordan Peele1 Deepfakes and Disinformation: Exploring the Impact of Synthetic Political Video on Deception, Uncertainty, and Trust in News, Cristian Vaccari et Andrew Chadwick, Mars 2020 | La vidéo: You Won’t Believe What Obama Says In This Video!, Jordan Peele/Buzzfeed News, le 17 avril 2018 , mettant en scène un deepfake de Barack Obama insultant Donald Trump a engrangé des millions de vues sur YouTube et déclenché une panique tenace chez tous les acteurs et les observateurs de la vie politique en occident.

Un deepfake satirique de Vladimir Poutine est apparu dès les premiers jours du conflit

Depuis, journalistes et organisations non gouvernementales observent le terrain de la désinformation à l’affut du moindre signe d’un deepfake politique capable de créer la fameuse Infocalypse promise par Nina Schick 2Infocalypse : la propagation des hypertrucages menace la société, , , , The Conversation, le 20 avril 2021 . Certaines vidéos ont bien provoqué quelques soubresauts locaux. Au Gabon, aux Philippines, en Inde, certains acteurs du monde politique ont, soit utilisé les deepfakes à leur avantage, soit été victimes de pressions à leur encontre orchestrées à l’aide de ces vidéos manipulées, mais rien qui n’ait jusque là ressemblé à une catastrophe démocratique. Pourtant les occasions d’expérimenter ces nouveaux objets de désinformation n’ont pas été des moindres : élections aux États-Unis, au Brésil, en Allemagne, en Europe…

À la guerre comme À la guerre

Le conflit qui oppose la Russie à l’Ukraine pourrait s’illustrer comme le premier véritable évènement mettant activement en scène des deepfakes dans le cadre d’une campagne de désinformation avérée. D’ores et déjà, le camp des soutiens ukrainiens a créé de très évidents deepfakes satyriques pour appeler à soutenir le président Zelensky et la population ukrainienne. Les fondateurs de l’app Reface 3 https://hey.reface.ai/ qui permet de réaliser des faceswaps à l’aide de son téléphone portable ont passé l’icône de l’app aux couleurs du drapeau ukrainien et ajouté une fonctionnalité permettant d’apposer son visage sur un clip de soutien reprenant les vidéos tournées par Zelensky dans les premiers jours de l’invasion.

La vidéo de soutien exportée avec mon visage pour l’occasion du test

D’autres vidéos circulent sur YouTube, notamment celle d’un extrait du film de Quentin Tarrentino, Inglorious Bastard que le créateur de deepfakes Crtl-Shift-Face a détourné pour réserver à Vladimir Poutine un sort peu enviable 4 Inglorious Bastard [Deepfake], Ctrl-Shift-Face, le 2 mars 2022 . En dépit du message qu’elles véhiculent, ces vidéos ne peuvent être confondues avec de véritables documents. On reste bien dans le registre de la parodie, de la manipulation évidente et il ne semble pas que le camp ukrainien ait produit de deepfakes dont l’objectif était de servir un message de propagande aux forces russes.

Propagande plus sérieuse

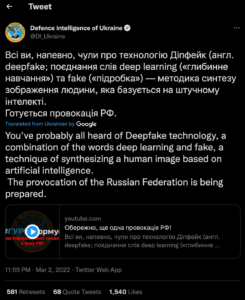

Tweet émanant du ministère de la défense ukrainien mettant en garde contre la possible diffusion de deepfakes faisant état d’une capitulation

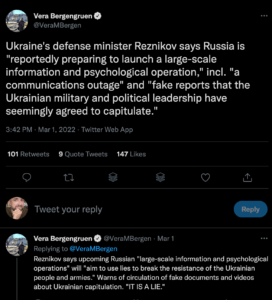

Côté Russe, la réalité est tout autre et on rapporte déjà un certain nombre de tentatives destinées à démobiliser les forces militaires ukrainiennes. Dans un tweet datant du 2 mars, le ministère de la Défense ukrainienne met en garde les populations et les militaires contre la diffusion de deepfakes faisant état d’une capitulation de Zelensky. Pour le moment aucune vidéo n’a fait surface, mais la menace semble suffisamment sérieuse pour qu’un communiqué officiel soit émis. Dans le même temps, Meta a annoncé avoir banni les profils d’une quarantaine de comptes opérés depuis la Russie et ciblant des attaques contre différents intérêts ukrainiens.

La correspondante de Time corrobore les déclarations du ministre de la Défense Reznikov.

« Au cours des dernières 48 heures, nous avons découvert un réseau relativement petit d’environ 40 comptes, pages et groupes sur Facebook et Instagram. Ils ont été exploités depuis la Russie et l’Ukraine et ont ciblé des personnes en Ukraine sur plusieurs plateformes de médias sociaux et via leurs propres sites Web. Nous avons supprimé cette opération, bloqué le partage de leurs domaines sur notre plate-forme et partagé des informations avec d’autres plates-formes technologiques, des chercheurs et des gouvernements. Lorsque nous avons interrompu ce réseau sur notre plate-forme, il y avait moins de 4 000 comptes Facebook qui suivaient l’une ou plusieurs de ses pages et moins de 500 comptes qui suivaient un ou plusieurs de ses comptes Instagram. » 5 Updates on Our Security Work in Ukraine, Meta, 27 février 2022.

Vladimir Bondarenko est un blogger pro russe basé à Kiev. C’est aussi une pure fiction dont le visage a été généré par un GAN.

Irina Kerimova de Kharkiv est un profil généré par une IA.

Ces comptes, rapporte Ben Collins 6 le thread de Ben Collins en date du 28 février 2022 sur Vladimir Bondarenko et Irina Kerimova , le correspondant de NBC News, disposaient de profils générés à l’aide d’un service du type ThisPersonDoesNotExist qui permet de créer des portraits synthétiques en quelques clics. D’autres cas de faux profils avaient fait parler d’eux comme ceux en 2020 de Maisy Kinsley et Katie Jones 7 Cybersécurité et deepfakes, une menace sérieuse, journalism.design, le 21 mars 2020 ou encore celui d’Oliver Taylor 8Oliver Taylor, étudiant modèle et pure fiction, journalism.design, le 28 juillet 2020.

La prolifération de faux comptes animés par des organes de renseignements privés ou sous contrat avec des états étrangers pose de plus en plus de problèmes notamment dans le cadre des secrets défense et du secret des affaires. Dans le cas du conflit Russo-Ukrainien, on assiste à une montée en puissance de l’effort de désinformation et de propagande dans lequel les deepfakes trouvent une place tout à fait pertinente. Les prochaines semaines permettront de voir si les peurs nourries au sujet des médias synthétiques s’avèrent justifiées ou si, pour cette fois-ci encore, leurs effets resteront marginaux.

Notes :

| ↑1 | Deepfakes and Disinformation: Exploring the Impact of Synthetic Political Video on Deception, Uncertainty, and Trust in News, Cristian Vaccari et Andrew Chadwick, Mars 2020 | La vidéo: You Won’t Believe What Obama Says In This Video!, Jordan Peele/Buzzfeed News, le 17 avril 2018 |

|---|---|

| ↑2 | Infocalypse : la propagation des hypertrucages menace la société, , , , The Conversation, le 20 avril 2021 |

| ↑3 | https://hey.reface.ai/ |

| ↑4 | Inglorious Bastard [Deepfake], Ctrl-Shift-Face, le 2 mars 2022 |

| ↑5 | Updates on Our Security Work in Ukraine, Meta, 27 février 2022 |

| ↑6 | le thread de Ben Collins en date du 28 février 2022 sur Vladimir Bondarenko et Irina Kerimova |

| ↑7 | Cybersécurité et deepfakes, une menace sérieuse, journalism.design, le 21 mars 2020 |

| ↑8 | Oliver Taylor, étudiant modèle et pure fiction, journalism.design, le 28 juillet 2020 |