En Corée du Sud, plusieurs dizaines de femmes 1103 victimes ont été recensées dont 24 mineuresont été victimes du réseau Nth Room. Derrière ce nom se cache une organisation cybercriminelle pratiquant entre autres le chantage, le trafic de contenus pornographiques, le harcèlement, l’extorsion et la diffusion massive de vidéos pornographiques et de deep-porns sur la messagerie Telegram.

❋

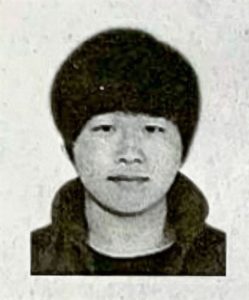

Cho Joo-bin, chef du réseau criminel Nth Room en Corée du Sud, sort d’un poste de police à Séoul le 25 mars : plus de 100 suspects ont été arrêtés dans le cadre du scandale du Telegram.

L’affaire bouleverse Séoul et le pays tout entier depuis quelques mois, un #metoo à la Coréenne dont on entend à peine parler en France. C’est le journal Coréen Hankyoreh qui a le premier révélé l’affaire. Au total, ce sont plus de 18 000 contenus pornographiques impliquant jeunes femmes et mineures qui ont été produits et diffusés pendant deux ans sur plusieurs groupes privés de l’application Telegram. Près d’une trentaine de « rooms » ont été identifiées à ce jour par les enquêteurs et d’après la police le réseau réunirait près de 260 000 membres, majoritairement situés en Corée, mais également ailleurs dans le monde. À la tête de cette opération tentaculaire, Cho Joo-bin, un jeune étudiant de 25 ans qui faisait payer jusqu’à 1200 € en crypto monnaies l’accès à ses chat-room.

Nombre de vidéos diffusées sur ce réseau se sont avérées être des deepfakes. Le visage de célébrités de la K-Pop 2La K-pop est le courant musical le plus populaire en Corée. Des groupes de jeunes hommes ou de jeunes femmes sont formés par des labels musicaux pour devenir de véritables idoles. Les coulisses de cette industrie ne sont pas roses puisque de nombreux cas de prostitution et de chantage sont régulièrement rapportés.3“Gangnam: The scandal rocking the playground of K-pop“, BBC News Seoul, 25 juin 2019 était alors apposé sur le corps de jeunes femmes victimes du chantage de Joo-Bin pour attirer de nouveaux membres, ceux-ci croyant ainsi obtenir des images secrètes de leurs stars favorites. Pour accéder aux chat-rooms les plus privées, certains de ces membres devaient en prouver leur valeur en produisant eux-mêmes des vidéos d’abus sexuels.

En mars, la police coréenne avait déjà interpellé près d’une centaine de personnes liées à l’affaire soit en tant qu’organisateurs, soit en tant que membre actif. Deux pétitions, une en Coréen l’autre en anglais ont réunis plus de 3 millions de signatures pour demander que l’identité des personnes incriminées soit révélée publiquement.

Les femmes : victimes privilégiées des deepfakes

L’affaire Nth Room montre bien comment la technologie peut-être dévoyée et utilisée à des fins d’exploitation criminelles. En octobre 2019, la société Sensity.ai 4Deeptrace a changé de nom pour Sensity.ai. Elle s’est fait connaitre grâce à la publication d’une étude montrant que près de 95 % des deepfakes étaient de nature pornographique montrait, chiffres à l’appui, la prévalence des contenus pornographiques dans la production de deepfakes. La raison est simple. Les deepfakes sont avant tout des contenus pornographiques. C’est sous cette forme qu’ils sont apparus en 2017 sur Reddit à travers le compte d’un utilisateur u/deepfakes qui fabriquait des vidéos pornographiques en apposant le visage de célébrités sur le corps d’actrices X. Si très rapidement les principaux sites pornographiques ont tenté de bannir les deepfakes 5“Pornhub Banned Deepfake Celebrity Sex Videos, But The Site Is Still Full Of Them” Buzzfeed News, 18 avril 2018, une myriade de petites plateformes dédiées ont éclos sur le web pour regrouper ces productions d’un nouveau genre.

Cette capture d’écran du site Pornhub montre qu’une recherche avec le terme deepfake fait remonter un certain nombre de vidéos malgré le bannissement.

Ces vidéos pornographiques ciblent traditionnellement des célébrités, mais un nombre non négligeable de femmes inconnues du grand public peuvent également être victimes de ces contenus. Il s’agit généralement de faire chanter les victimes, d’imposer une forme de domination à leur encontre, de dégrader leur image, leur réputation ou d’assouvir des fantasmes sexuels, voire d’obtenir un levier politique à leur encontre.

Premier rôle de la dernière trilogie Star Wars, l’actrice britannique Daisy Ridley a comme beaucoup d’autres été victime d’un faceswap 6le faceswap est une technique consistant à apposer numériquement le visage d’une personne sur le corps d’une autre à l’aide d’algorithmes spécialisés dans la création de deepfakes dès 2017. Gal Gadot, l’actrice incarnant Diana Prince dans le film Wonder Woman, Emma Watson, l’actrice incarnant Hermione Granger dans les films Harry Potter, Maisy Williams qui incarnait Arya Stark dans la série Game of Thrones ou encore Scarlett Johansson qui incarnait Black Widow dans la série de films Avengers ont toutes vu leur visage utilisé dans des vidéos pornographiques. En juin dernier, Kristen Bell, actrice américaine récemment vu dans « The Good Place » confiait à un journaliste de Vox être choquée d’avoir découvert par hasard que son visage avait été utilisé pour fabriquer des vidéos pornos 7“Kristen Bell says she was ‘shocked’ to learn that her face was used in a pornographic deepfake video » insider.com, 11 juin 2020.

Les deep-porns peuvent également avoir un rôle plus politique. Par exemple en 2018, la journaliste indienne Ranya Ayyub a raconté dans les colonnes du Huffington Post 8“I Was The Victim Of A Deepfake Porn Plot Intended To Silence Me” Ranya Ayyub, Huffington Post, 21 novembre 2018 comment son image avait été utilisée dans un deep-porn destiné à démolir sa crédibilité de journaliste et la réduire au silence 9 (2020) ‘A Deepfake Porn Plot Intended to Silence Me’: exploring continuities between pornographic and ‘political’ deep fakes, Porn Studies, DOI: 10.1080/23268743.2020.1757499.

Noelle Martin, jeune australienne anonyme, a également été victime de harcèlement suite à la diffusion de deep-porns la concernant 10“Deepfake Porn Nearly Ruined My Life » Elle.co.uk, 6 février 2020. Son témoignage montre à quel point le traumatisme l’a bouleversé et comment sa vie a simplement basculé en un claquement de doigts.

Les victimes ne sont pourtant pas seulement celles à qui le visage est pris pour être collé sur le corps d’actrices X. Les actrices de film pornographique sont elles-mêmes les victimes d’une situation qui leur échappe 11“Deepfake Porn Harms Adult Performers, Too », Wired, 15 janvier 2020. À leur corps défendant, elles deviennent l’arme anonyme d’une humiliation publique en donnant chair aux fantasmes inaccessibles de certains. Leur corps prend part au harcèlement de ces femmes connues ou inconnues sans qu’elles ne puissent jamais s’en dissocier.

Les deep-porns : un instrument d’oppression

C’est tout d’abord une question de consentement qui se pose. Le consentement à apparaitre dans une vidéo, le consentement à donner son corps en pâture, le consentement à devenir l’objet de fantasmes. Qu’elles soient actrices de films traditionnels ou pour adultes, journalistes, femmes d’affaires, écrivaines ou artistes, célèbres ou anonymes, les premières victimes des deep-porns sont les femmes. Aucune d’entre elles n’a jamais donné son consentement pour apparaitre nue dans une vidéo, quelle que soit la partie de son corps représenté.

Puis vient la question des auteurs, qui sont les créateurs de ces deep-porns ? Parce qu’on parle bien de créateurs et pas de créatrices. Il s’agit pour eux de créer un corps artificiel, de toutes pièces, réceptacle d’abord de ses propres fantasmes. Il faut assembler les visages, la collection de photographies qui permettront de « greffer » numériquement la célébrité sur le corps de l’actrice dénudée. Puis trouver le corps, celui qui accueillera le nouveau visage. On parle de données, de larges volumes de données, de représentation numérique de formes, de textures, de géométrie. Pour créer ces vidéos, il ne faut plus voir les corps, il faut voir les pièces, les morceaux qu’on assemble, au-delà du sexe et du plaisir ou de la chair. Il faut objectifier jusqu’au dernier centimètre de peau pour ne pas questionner sa pratique. Le corps réassemblé peut ainsi servir à nouveau, comme une belle bagnole qu’on a ainsi rafistolée avec différentes pièces.

Le fantasme dans cette affaire n’est pas tout. Il s’agit aussi d’imposer sa vision de la femme. D’abord en l’humiliant (mais après tout, il n’y a plus de corps ni de personne dans leur raisonnement), puis en la manipulant, enfin en supprimant son identité. L’actrice de film pour adultes s’efface derrière un masque, et le masque perd la personnalité qui lui était propre en devenant autre chose, l’objet d’un désir aux mimiques fausses et simulées.

Parfois, la haine et la colère viennent compléter le sinistre tableau. Le deep-porn devient — comme dans l’affaire Nth Room ou dans le cas de la journaliste Ranya Ayyub — l’objet d’un chantage. Là encore, il s’agit d’humilier, d’imposer le silence, de manipuler voire de nier l’existence de l’autre.

Ces vidéos ne sont que l’expression d’un mal largement documenté sur les abus sexuels sur enfants 12 2020. Australians who view live streaming of child sexual abuse: An analysis of financial transactions. Trends & issues in crime and criminal justice no. 589. Canberra: Australian Institute of Criminology. sur l’esclavage sexuel moderne ou les violences faites aux femmes 13 Responding to Revenge Pornography : Prevalence, Nature and Impacts. Henry, Nicola ; Flynn, Asher ; Powell, Anastasia. Canberra ACT Australia: Australian Research Council, 2019. 126 p..

L’affaire Nth Room révèle une autre facette des deepfakes et met en exergue leur possible usage criminel. Nombre de questions légales, éthiques, morales, sociétales restent à explorer notamment la responsabilité de Google ou de Microsoft qui hébergent la plupart des modèles utilisés pour créer des deepfakes. Mais c’est également notre responsabilité de consommateur et de citoyen qu’il s’agit d’interroger face à ces abus criminels, pour qu’on puisse éviter à des centaines de femmes de voir leur visage, un jour leur échapper pour devenir un objet sexuel de plus dans la bibliothèque numérique d’un quelconque bonhomme.

Notes :

| ↑1 | 103 victimes ont été recensées dont 24 mineures |

|---|---|

| ↑2 | La K-pop est le courant musical le plus populaire en Corée. Des groupes de jeunes hommes ou de jeunes femmes sont formés par des labels musicaux pour devenir de véritables idoles. Les coulisses de cette industrie ne sont pas roses puisque de nombreux cas de prostitution et de chantage sont régulièrement rapportés. |

| ↑3 | “Gangnam: The scandal rocking the playground of K-pop“, BBC News Seoul, 25 juin 2019 |

| ↑4 | Deeptrace a changé de nom pour Sensity.ai. Elle s’est fait connaitre grâce à la publication d’une étude montrant que près de 95 % des deepfakes étaient de nature pornographique |

| ↑5 | “Pornhub Banned Deepfake Celebrity Sex Videos, But The Site Is Still Full Of Them” Buzzfeed News, 18 avril 2018 |

| ↑6 | le faceswap est une technique consistant à apposer numériquement le visage d’une personne sur le corps d’une autre à l’aide d’algorithmes spécialisés dans la création de deepfakes |

| ↑7 | “Kristen Bell says she was ‘shocked’ to learn that her face was used in a pornographic deepfake video » insider.com, 11 juin 2020 |

| ↑8 | “I Was The Victim Of A Deepfake Porn Plot Intended To Silence Me” Ranya Ayyub, Huffington Post, 21 novembre 2018 |

| ↑9 | (2020) ‘A Deepfake Porn Plot Intended to Silence Me’: exploring continuities between pornographic and ‘political’ deep fakes, Porn Studies, DOI: 10.1080/23268743.2020.1757499 |

| ↑10 | “Deepfake Porn Nearly Ruined My Life » Elle.co.uk, 6 février 2020 |

| ↑11 | “Deepfake Porn Harms Adult Performers, Too », Wired, 15 janvier 2020 |

| ↑12 | 2020. Australians who view live streaming of child sexual abuse: An analysis of financial transactions. Trends & issues in crime and criminal justice no. 589. Canberra: Australian Institute of Criminology. |

| ↑13 | Responding to Revenge Pornography : Prevalence, Nature and Impacts. Henry, Nicola ; Flynn, Asher ; Powell, Anastasia. Canberra ACT Australia: Australian Research Council, 2019. 126 p. |